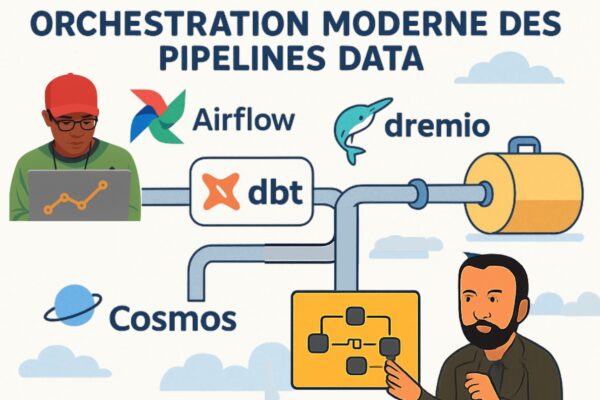

Apache Airflow®

Apache Airflow® est une plateforme open source de gestion, d’orchestration et de supervision des workflows de données.

Apache Airflow® permet aux ingénieurs data, développeurs et équipes DevOps de concevoir, planifier et monitorer des pipelines complexes de manière déclarative, modulaire et scalable. Grâce à son approche DAG (Directed Acyclic Graph), chaque étape du traitement est définie comme un bloc réutilisable, facilitant la traçabilité, la reprise sur erreur et l’automatisation.

Extensible

Extensible Intégrations puissantes

Intégrations puissantes